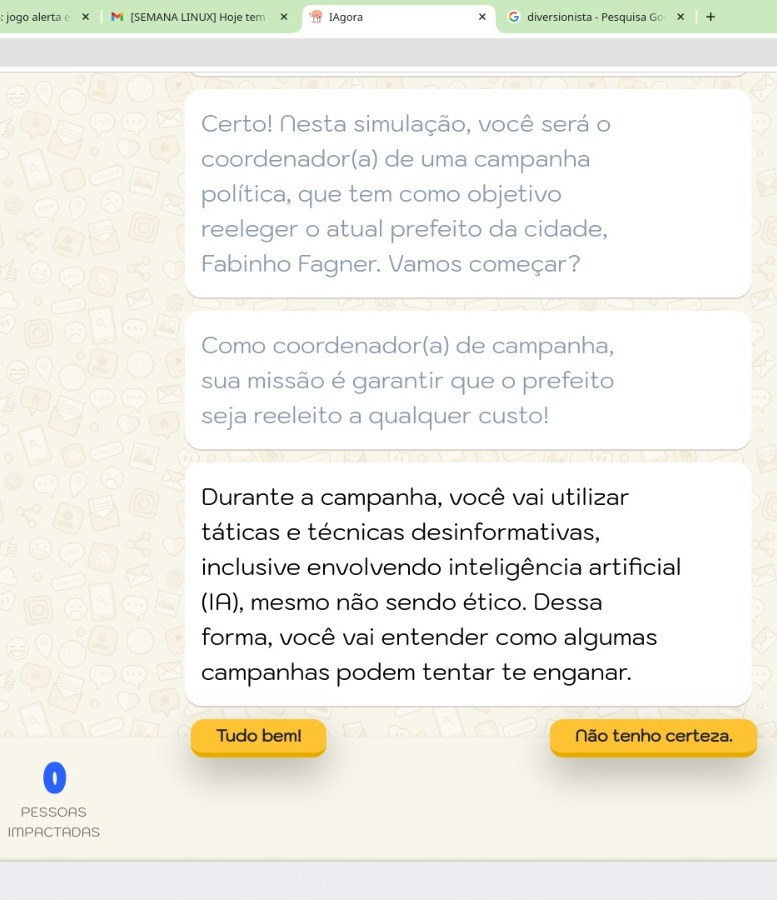

Um jogo para ensinar sobre falsidades na campanha eleitoral é a iniciativa da Agência Lupa, primeira agência de fact-checking do Brasil, em consórcio com a Politize!, organização dedicada à educação política, e a App Cívico, uma consultoria em projetos de tecnologia cívica. O jogo digital IAgora funciona como um simulador de uma campanha eleitoral. Na brincadeira, o jogador assume o papel de marqueteiro e coordenador da campanha de reeleição de um prefeito fictício, mas com desafios e estratégias familiares ao noticiário político brasileiro.

Imagem: IAgora.org

No IAgora, eleitores podem aprender, na prática, como identificar e se proteger das táticas e técnicas de manipulação usadas para enganar o público com o uso de ferramentas de inteligência artificial (IA). De acordo com os desenvolvedores, o jogo atua como uma “vacina” contra a desinformação: ao jogá-lo, o jogador desenvolve resistência cognitiva contra as formas comuns de desinformação que poderá encontrar durante as eleições.

Identificar os inimigos da democracia

Em um fluxo de jogo simples e intuitivo, IAgora mostra ao usuário, no papel de coordenador de campanha, como usar cinco táticas de manipulação com grande potencial de ajudar seu candidato a ganhar uma eleição. São elas:

- Emoção – marcada pelo uso de termos chamativos que remetem à urgência e provocam sentimentos intensos (medo, raiva, alegria, rejeição, identificação) no eleitor;

- Teorias da Conspiração – utiliza ferramentas para provocar dúvidas, inseguranças, medos e desconfiança em relação às instituições e autoridades, inclusive no próprio processo eleitoral;

- Polarização – combina a simplificação de questões complexas com a criação de supostos inimigos, reduzindo um tema ou um debate plural a apenas dois polos;

- Trollagem – usa de conteúdos de humor para provocar agitação, ofensas e discórdia;

- Falso Especialista – busca validar determinada visão sobre um tema polêmico por meio de um indivíduo ou grupo que se apresenta como autoridade no assunto, mas não possui conhecimento ou qualificação real.

Desse modo, o jogador é convidado a usar ferramentas de inteligência artificial para manipular imagens verdadeiras, produzir áudios, vídeos e perfis falsos durante a corrida eleitoral. Além de mostrar o impacto e as consequências do uso da desinformação, IAgora explica porque essa tática ainda é um recurso muito usado na política:

“Mesmo que parte da população saiba que o áudio é falso, a maioria das pessoas que recebeu essa mensagem não vai nem desconfiar da veracidade. Isso acontece porque as pessoas recebem os áudios em grupos de pessoas que confiam, como os grupos de família. Com isso, vão acreditar e relacionar inconscientemente uma imagem positiva do seu candidato à educação.”

Educação para IA e o exercício da cidadania

A indústria da desinformação ganhou escala nas últimas eleições com a ajuda da IA, comprometendo as democracias em diversos países pelo mundo. Nesse sentido, IAgora chega para preencher uma lacuna no campo da educação para o exercício da cidadania nas eleições no que diz respeito ao voto. A iniciativa reconhece que a liberdade para a escolha consciente dos candidatos vem sendo ameaçada pela disseminação da desinformação, o que é popularmente conhecido como fake news, mas inclui muito mais do que é falso, como o Bereia tem mostrado com as checagens.

O pesquisador da Universidade Federal de Juiz de Fora João Pedro Chevi, no artigo Info-víduo: novas tecnologias geram novas demandas descreve com clareza a ideia básica de funcionamento daquilo que nos acostumamos a chamar de IA,

“[…] nada de radicalmente novo pode passar a existir através da IA, já que todas as possibilidades de mutações devem se situar dentro do espaço de possibilidades definido pelo programa. Para algo existir, precisa ser percebido no mundo exterior, portanto, se não percebemos e transcrevemos para a máquina, esta coisa não é uma possibilidade, uma vez que os programas consomem informações de bancos de dados. Logo, de acordo com biólogos e filósofos, apenas biologicamente seria possível a criação de novos sensores perceptivos.”

Dessa maneira, ainda que os algoritmos conhecidos como inteligência artificial não sejam capazes de raciocinar ou perceber o mundo como os seres humanos, todavia, podem predizer cenários e tendências, bem como influenciar as escolhas humanas. Seria possível até mesmo “construir” mundos paralelos, por conta da magnitude dos dados (entregues livremente pelos usuários) que alimentam esses sistemas digitais orientados a mecanismos estatísticos de altíssima complexidade.

É assim que a IA pode influenciar usuários de mídias sociais num cenário de eleições municipais, por exemplo. Isto ocorre na medida em que o perfil de cada usuário e seu mundo (características pessoais, relações sociais, gostos, desgostos, opções políticas, sociais, sexuais, culturais, etc) é copiado para dentro da base de dados manipulada pela inteligência artificial.

O professor Sérgio Amadeu da Silveira, da Universidade Federal do ABC, um dos maiores especialistas no assunto exemplifica bem este processo:

“[…] aqueles códigos invisíveis que agem na internet, orientando o resultado das buscas que fazemos, decidindo pelo usuário da rede social quem aparecerá na timeline dele ou para quais amigos suas postagens serão exibidas e ainda escolhendo os anúncios que milagrosamente aparecem nos sites e aplicativos – são também capazes de agir, ainda que indiretamente, sobre o comportamento e as posturas dos internautas.”

Obviamente, para o funcionamento eficiente dessas ferramentas sempre tem alguém ou algum grupo de interessados que definem as regras e os parâmetros de funcionamento de um sistema digital baseado em inteligência artificial. Não poucas vezes isso é usado para atingir objetivos de lucro ou poder a qualquer custo, sem respeito à realidade dos fatos ou a valores éticos, exatamente como acontece na realidade fictícia proposta pelo game.

Imagem: IAgora.org

É justamente neste contexto, de ausência de educação digital ou mesmo de ausência de uma educação para o manejo das mídias digitais, no cenário da comunicação social, sobretudo em tempos de pós-verdade, como o atual momento histórico, que a manipulação acontece em escala, com o auxílio da IA.

Razão porque existe o trabalho árduo de agências de checagem de notícias, como o Coletivo Bereia e a Agência Lupa, entre outros projetos, que, além de prestarem o necessário serviço de fact checking (checagem de notícias) à sociedade, também oferecem bons serviços de educação cidadã no campo do jornalismo e da comunicação social.

Referências

IAgora, ONLINE. https://iagora.org/about. Acesso 17 set 2024.

GAMEREPORTER. https://www.gamereporter.com.br/politize/. Acesso 17 set 2024.

JOÃO PEDRO CHEVI. https://medium.com/@projetomemoria8/info-v%C3%ADduo-novas-tecnologias-geram-novas-demandas-bafcb6dacbe3. Acesso 17 set 2024.

Elisa Marconi e Francisco Bicudo. https://revistagiz.sinprosp.org.br/cultura/como-algoritmos-afetam-a-democracia/. Acesso em 18 set 2024.